Submit Script ALELEON Supercomputer: Perbedaan antara revisi

WilsonLisan (bicara | kontrib) (menambahkan struktur SLURM Script) |

WilsonLisan (bicara | kontrib) (→Bagaimana Menentukan Alokasi Jumlah nodes, ntasks, dan mem: link banner) |

||

| Baris 128: | Baris 128: | ||

Admin EFISON merangkum ''rules of thumb'' bagi user untuk mengalokasikan jumlah resources komputasi dan melakukan optimasi performa pada ALELEON Supercomputer di: | Admin EFISON merangkum ''rules of thumb'' bagi user untuk mengalokasikan jumlah resources komputasi dan melakukan optimasi performa pada ALELEON Supercomputer di: | ||

[[Berkas:Wiki-13.jpg|1000x1000px]] | [[Berkas:Wiki-13.jpg|1000x1000px |link=Optimasi Performa ALELEON Supercomputer| alt=Optimasi Performa ALELEON Supercomputer ]] | ||

| | | | ||

Revisi per 4 Februari 2022 12.37

Halaman ini menjelaskan panduan memahami dan mengisi parameter resources pada SLURM Script beserta contohnya berdasarkan hardware ALELEON Supercomputer.

Struktur SLURM Script

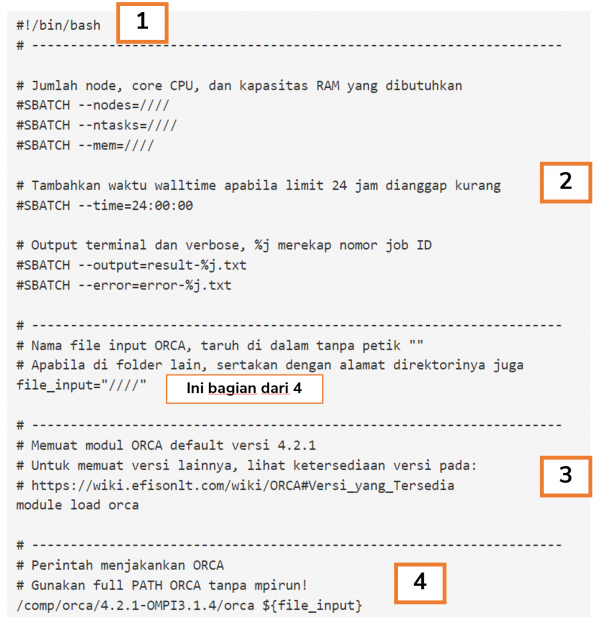

Secara umum, Submit Script atau SLURM Script dipecah menjadi 4 bagian penting.

Penjelasan dan langkah user membuat SLURM Script:

- Menulis header #!/bin/bash karena SLURM Script adalah bash script.

- Membuat dan menentukan parameter SBATCH untuk mengalokasikan resources job seperti CPU, RAM, GPU, time, dll.

- Memuat software yang dibutuhkan untuk menjalankan job user dengan Module Environment. Apabila user tidak memuat modul software yang benar maka job tidak akan berjalan.

- Menulis perintah untuk menjalankan program user.

|

Lauk apa yang akan dipesan?

Dalam menggunakan superkomputer, user menentukan sendiri alokasi resources komputasi untuk menjalankan job seperti jumlah core CPU, RAM, GPU, walltime, file output, notifikasi email, threading CPU, dll. Analogikan seperti kita hendak pesan bungkus di warung makan nasi padang di mana kita menentukan sendiri berapa porsi yang mau dibungkus, jenis lauk, dan jumlahnya.

Resources ALELEON Supercomputer di SLURM

Sebelum menentukan alokasi resource job, user harus mengetahui spesifikasi hardware dari ALELEON Supercomputer:

- Partisi epyc atau pengelompokan Compute Node CPU.

- 3 Node (unit server), total 192 core fisik / 384 core thread CPU

- Masing-masing node berisikan:

- 64 core fisik / 128 core thread CPU

- RAM 240GB.

- Secara default, komputasi pada ALELEON Supercomputer diarahkan ke Partisi epyc.

- Partisi gpu_ampere atau pengelompokan Compute Node GPU

- 1 Node, total 2 GPU

- CPU 64 core fisik / 128 core thread CPU

- RAM 125GB.

- 1 Node, total 2 GPU

Info lebih detail dapat dipelajari pada laman Spesifikasi ALELEON Supercomputer.

Core Thread CPU pada ALELEON Supercomputer

EFISON menggunakan CPU AMD EPYC 7702P pada Partisi epyc dan AMD Threadripper 3990X pada Partisi gpu_ampere. EFISON mengaktifkan SMT (Simultaneous Multi-Threading) pada semua CPU AMD di ALELEON Supercomputer sehingga masing-masing CPU mempunyai 2 core thread per 1 core fisik.

Secara default, penggunaan CPU pada ALELEON Supercomputer didasarkan pada core thread, termasuk penghitungan penggunaan komputasi CPU Core Hour user.

Parameter Resources SBATCH Esensial

Terdapat ratusan jenis parameter SBATCH pada SLURM dari yang standar hingga advanced. Admin EFISON merangkum parameter esensial yang digunakan pada ALELEON Supercomputer.

Menggunakan Compute Node CPU / Partisi epyc

Berikut adalah parameter SBATCH yang direkomendasikan dan secara umum dapat digunakan untuk semua jenis job:

# user mengisi parameter dengan mengganti bagian yang ditandai dengan //// #SBATCH --nodes=//// #SBATCH --ntasks=//// #SBATCH --mem=//// #SBATCH --time=//// #SBATCH --output=//// #SBATCH --error=////

- nodes

- Alokasi jumlah node yang digunakan.

- Contoh mengalokasikan 1 node: #SBATCH --nodes=1

- ntasks

- Alokasi jumlah core thread CPU yang digunakan.

- Contoh mengalokasikan 32 core thread CPU: #SBATCH --ntasks=32

- mem

- Alokasi kapasitas RAM per node yang digunakan, diikuti dengan satuan KB, MB, atau GB.

- Contoh mengalokasikan RAM 32GB: #SBATCH --mem=32GB

- time

- Alokasi walltime (waktu maksimal) yang diizinkan untuk menjalankan job, mengikuti format penulisan:

- HH:MM:SS. Contoh alokasi 2 jam: #SBATCH --time=02:00:00

- D-HH:MM:SS. Contoh alokasi 2 hari: #SBATCH --time=2-00:00:00

- Alokasi walltime (waktu maksimal) yang diizinkan untuk menjalankan job, mengikuti format penulisan:

- output

- Merekap output program yang keluar di terminal. User memberikan sendiri nama file (satu kata tanpa spasi) diikuti dengan format file seperti .txt atau .out yang sering digunakan.

- Terdapat penamaan pattern dari SLURM yaitu %j yang merekap job-ID.

- Contoh penamaan output yang sering digunakan: #SBATCH --output=result-%j.txt

- Apabila job berjalan dengan no. ID 2555, maka nama output menjadi result-2555.txt

- error

- Merekap output verbose program yaitu status jalannya program seperti "job sudah berjalan!" dan error log ketika program gagal selesai.

- Output error sangat bermanfaat bagi user untuk melakukan troubleshooting disaat program gagal berjalan. Admin EFISON selalu merekomendasikan user untuk selalu menggunakan parameter error ini.

- Format penamaan mengikuti parameter output diatas, contoh: #SBATCH --error=error-%j.txt

|

Menggunakan Compute Node GPU / Partisi gpu_ampere

Secara umum mengikuti format SBATCH yang sama dengan menggunakan Partisi epyc, diikuti dengan tambahan:

# user mengisi parameter dengan mengganti bagian yang ditandai dengan //// #SBATCH --partition=gpu_ampere #SBATCH --gres=gpu://// #SBATCH --ntasks=//// #SBATCH --mem=//// #SBATCH --time=//// #SBATCH --output=//// #SBATCH --error=////

- partition=gpu_ampere

- Mengalokasikan job ke Compute Node GPU gpu_ampere

- gres=gpu:<jumlah-GPU>

- Alokasi Jumlah GPU yang digunakan.

- Contoh mengalokasikan 1 GPU: #SBATCH --gres=gpu:1

- Contoh mengalokasikan 2 GPU: #SBATCH --gres=gpu:2

|

Notifikasi Status Jalannya Job via E-mail

SLURM pada ALELEON Supercomputer dapat mengirim notifikasi email kepada user untuk mengabarkan apabila job user sudah berjalan atau selesai. SLURM ALELEON Supercomputer menggunakan nama email Jojo untuk mengirim notifikasi email. User dapat menambahkan parameter berikut untuk menerima notifikasi email dari SLURM:

#SBATCH --mail-user=//// #SBATCH --mail-type=begin #SBATCH --mail-type=end

- mail-user

- Alamat email user untuk menerima notifikasi SLURM

- mail-type=begin

- Notifikasi email yang menginfokan job sudah mulai.

- mail-type=end

- Notifikasi email yang menginfokan job sudah selesai.

- Sekaligus memberikan cuplikan 20 baris terakhir dari SBATCH output dan error job user.

|

Menggunakan Paralelisasi Threading OpenMP atau BLAS

Berikut adalah parameter tambahan untuk mengalokasikan threading per core para programyang menggunakan paralelisasi OpenMP (OMP), hybrid MPI/OMP, atau terintegrasi dengan BLAS:

#SBATCH --cpus-per-task=//// # diikuti dengan pengalokasikan threads contoh dengan OMP: export OMP_NUM_THREADS=$SLURM_CPUS_PER_TASK

- cpus-per-task

- Alokasi jumlah threading per ntasks.

- User mendefinisikan jumlah threading (contoh ke OMP_NUM_THREADS) dengan variabel $SLURM_CPUS_PER_TASK.

- Contoh mengalokasikan 4 thread per core: $SBATCH --cpus-per-task=4

Bagaimana Menentukan Alokasi Jumlah nodes, ntasks, dan mem

Seni dalam menggunakan superkomputer adalah kebebasan user dalam menentukan jumlah core prosesor, RAM, dan node yang akan digunakan. Apakah program user cukup menggunakan 8 core atau sekalian 64 core? Apakah program user hanya dapat berjalan pada 1 node atau bisa lebih? Apakah RAM 16GB sudah cukup atau butuh lebih? Hal ini ditambah dengan ALELEON Supercomputer dan arsitektur AMD EPYC mempunyai beberapa aturan khusus supaya user dapat memanfaatkan kemampuan komputasinya dengan optimal.

Admin EFISON merangkum rules of thumb bagi user untuk mengalokasikan jumlah resources komputasi dan melakukan optimasi performa pada ALELEON Supercomputer di:

|

Jumlah Core CPU: Kelipatan 4

Berdasarkan arsiktektur CPU AMD yang digunakan oleh ALELEON Supercomputer, user direkomendasikan untuk memilih jumlah core CPU (ntasks) berdasarkan kelipatan 4, dimulai dari 1,2,4, kemudian naik kelipatan 4 menjadi 8, 12, 16, 20, 24, 28, 32, 36, 40, dan seterusnya.

|

Semakin Besar Jumlah Core CPU = Komputasi Semakin Cepat?

Bisa iya bisa tidak. Besar jumlah core CPU yang dibutuhkan bergantung pada:

- Apabila menjalankan program CPU: bergantung pada besarnya skala input komputasi user. Admin ALELEON Supercomputer sepenuhnya menyerahkan tanggung jawab kepada user untuk mengetahui sendiri apakah input komputasi yang dijalankan adalah skala kecil atau besar.

- Input komputasi skala kecil cukup membutuhkan jumlah core kecil (rekomendasi dibawah 16) dan bisa jadi lambat apabila dijalankan dengan jumlah core besar.

- Apabila user yakin bahwa input yang dijalankan adalah skala besar maka gunakan jumlah core CPU yang besar seperti 32, 64, 128, atau diatasnya.

- Apabila menjalankan program GPU: kebanyakan membutuhkan jumlah core kecil (dibawah 16) karena pada dasarnya semua komputasi dikerjakan oleh GPU. Cukup jarang ada program GPU yang membutuhkan jumlah core CPU besar.

|

Memperkirakan Kapasitas RAM yang Digunakan

Apakah program user membutuhkan banyak RAM atau tidak? Tidak ada aturan baku untuk mengetahui hal ini karena bergantung dengan jenis software dan besarnya skala input yang dijalankan user. Admin EFISON dapat memberikan saran untuk menggunakan jumlah RAM 1GB per ntasks sebagai basis. Contoh:

- ntasks=8, alokasikan mem 8GB.

- ntasks=32, alokasikan mem 32GB.

User dapat menggunakan kapasitas RAM yang lebih besar (contoh 2GB atau 4GB per ntasks) apabila user mengetahui bahwa program yang dijalankan membutuhkan kapasitas RAM besar atau program gagal berjalan dengan alokasi RAM 1GB per ntasks.

|

Menentukan Jumlah Node: Program MPI versus Non-MPI

Terdapat dua kategori besar pada program komputasi yang dijalankan pada superkomputer yaitu program MPI dan non-MPI:

- Program MPI adalah program yang ditulis berdasarkan pemrograman MPI (Message Parallel Interface) di mana dapat berjalan secara paralel atau lebih dari satu node (multi-node). Berjalan multi-node artinya dapat memanfaatkan lebih dari 128 core thread CPU pada ALELEON Supercomputer.

- Program non-MPI adalah program yang tidak ditulis dengan pemodelan MPI sehingga hanya dapat berjalan pada 1 node.

|

Program Non-MPI: Hanya Dapat Menggunakan 1 Node

Program non-MPI hanya dapat berjalan pada 1 node sehingga menggunakan alokasi ntasks antara 1 hingga 128 core thread CPU.

#SBATCH --nodes=1 #SBATCH --ntasks= #antara 1 - 128

User perlu mengetahui:

- Program komputasi non-MPI dapat berjalan secara multi-core (lebih dari 1 core) atau hanya bisa berjalan dengan 1 core (ntasks=1) tergantung oleh jenis software dan pemrogramannya.

- Program komputasi non-MPI yang hanya berjalan 1 core sering terjadi pada program yang ditulis sendiri oleh user atau framework komputasi yang ditulis dengan standar pemrograman serial.

- Bagi user yang tidak ingin programnya berjalan di ALELEON Supercomputer hanya dengan 1 core, Admin EFISON menyarankan untuk menguji terlebih dahulu dengan menjalankannya pada perangkat komputer pribadi dan lihat status penggunaan CPU-nya.

- User dapat mengganti coding apabila terjadi pada program yang ditulis sendiri.

- Apabila menggunakan software komputasi maka user harus mencari alternatif software pengganti.

Untuk program komputasi non-MPI yang memanfaatkan paralelisasi threading OpenMP dan membutuhkan parameter OMP_NUM_THREAD, gunakan kombinasi parameter berikut:

#SBATCH --nodes=1 #SBATCH --ntasks=1 #SBATCH --cpus-per-task= #antara 1 - 128 export OMP_NUM_THREADS=$SLURM_CPUS_PER_TASK

|

Program MPI: Menggunakan 1 Node atau Lebih

Ketika menjalankan program MPI di ALELEON Supercomputer, user dapat mengalokasikan resources:

- Tetap menggunakan 1 node / 128 core.

- Menggunakan lebih dari 1 node / lebih dari 128 core.

Apabila user menjalankan program komputasi yang tersedia di ALELEON Supercomputer, user dapat mengetahui bahwa program tersebut adalah MPI atau tidak dengan memperhatikan kolom "Dukungan MPI" di tabel daftar software komputasi ALELEON Supercomputer.

|

Pembagian Proses MPI Pada Core CPU ALELEON Supercomputer

Terdapat tiga aturan pada perintah MPI (mpirun atau mpiexec) yang diberlakukan pada ALELEON Supercomputer yaitu:

- Satu proses MPI mewakili satu core thread CPU atau satu ntasks. Artinya, jumlah proses MPI sama dengan jumlah ntasks.

- Berlaku aturan kelipatan 4 pada jumlah ntasks.

- Secara standar, total proses MPI akan selalu mengisi 2 core thread per core fisik. Artinya:

- Contoh 32 proses MPI berjalan pada 16 core fisik / 32 core thread.

- Contoh lain 128 proses MPI berjalan pada 64 core fisik / 128 core thread.

|

Efisiensi Menjalankan Program MPI dan Penggunaan Multi-Node di ALELEON Supercomputer

Terdapat hal teknis yang harus diketahui user untuk menjalankan program MPI dengan efisiensi performa yang baik pada sistem superkomputer apapun termasuk ALELEON Supercomputer seperti:

- Efisiensi core thread versus core fisik pada program MPI.

- Affinity mpirun (binding by core / thread / socket / dll).

- Bagaimana cara menjalankan MPI pada multi-node dengan efisien.

Contoh SLURM Script

EFISON merangkum contoh SLURM script untuk penggunaan berbagai skenario komputasi pada laman Contoh SLURM Script.

Contoh SLURM Script Software Spesifik

EFISON juga merangkum contoh SLURM script untuk software komputasi saintifik pada laman Software di HPC Aleleon Mk.II.